Các chiến dịch lừa đảo bằng trí tuệ nhân tạo (AI) đang trở nên cực kỳ khó phát hiện. Với khả năng cải thiện đáng kể về chính tả, ngữ pháp và cấu trúc câu, kẻ lừa đảo đang tận dụng AI để làm cho các chiêu trò lừa đảo trực tuyến trở nên hợp pháp và đáng tin cậy hơn bao giờ hết. Tuy nhiên, đừng lo lắng, bạn hoàn toàn có thể trang bị kiến thức để nhận diện các chiến dịch lừa đảo AI tinh vi này và tự bảo vệ mình khỏi việc trở thành nạn nhân.

1. Phân Tích Kỹ Ngôn Ngữ Email

Trong quá khứ, chỉ cần một cái lướt mắt nhanh chóng cũng đủ để nhận ra sự bất thường trong email, thường là do ngữ pháp sai và lỗi chính tả ngớ ngẩn. Nhưng giờ đây, khi kẻ lừa đảo sử dụng các mô hình ngôn ngữ AI tạo sinh, hầu hết các tin nhắn lừa đảo (phishing) đều có ngữ pháp hoàn hảo.

Tuy nhiên, không phải tất cả đều vô vọng. Mặc dù các mô hình như ChatGPT và các công cụ tương tự đang tiến gần đến mức không thể phân biệt với ngôn ngữ tự nhiên của con người, việc phát hiện văn bản do AI tạo ra vẫn tương đối dễ dàng. Dòng chảy của câu văn thường không tự nhiên – có thể nói, manh mối lớn nhất là mọi thứ trông “quá hoàn hảo”.

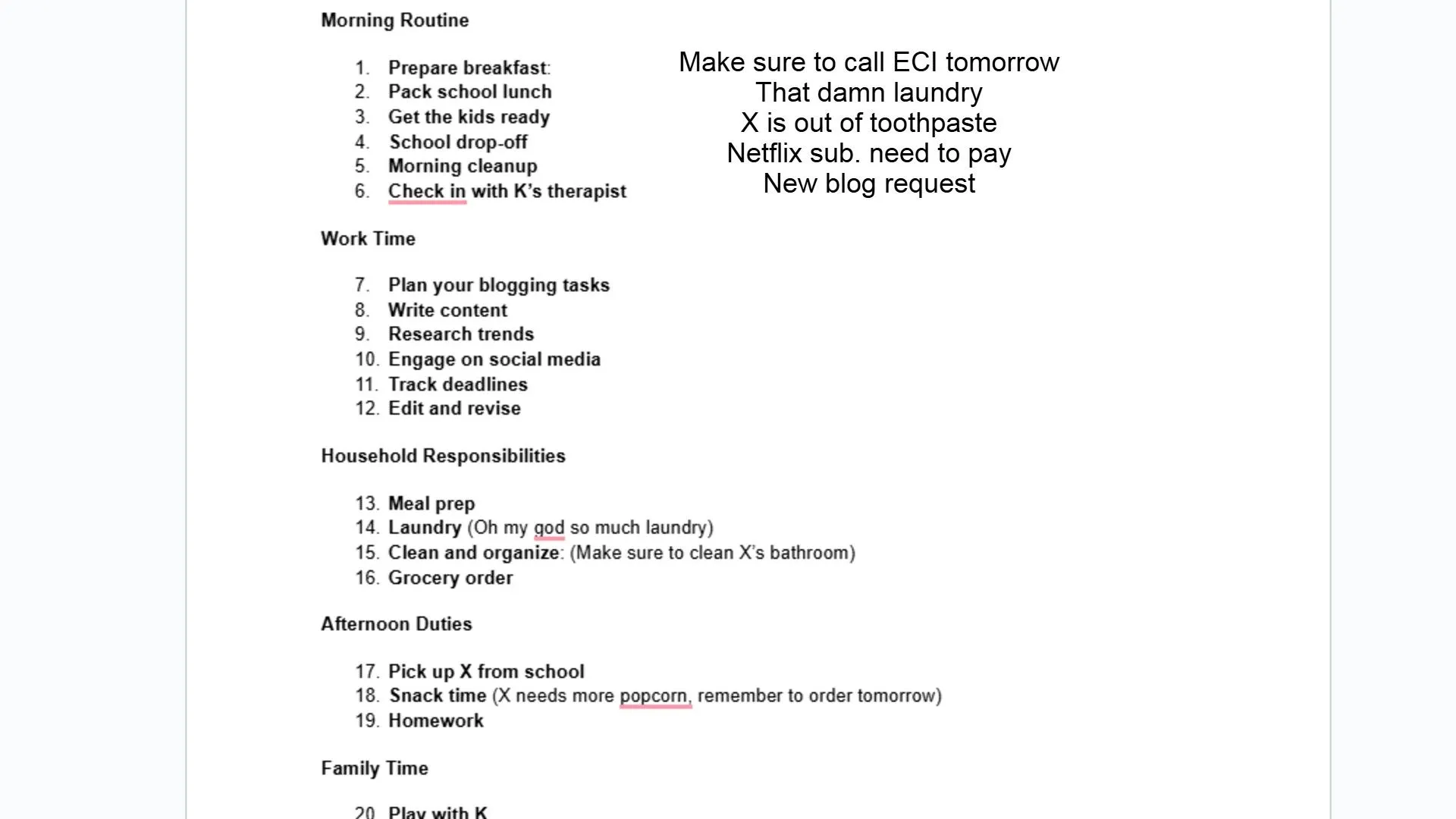

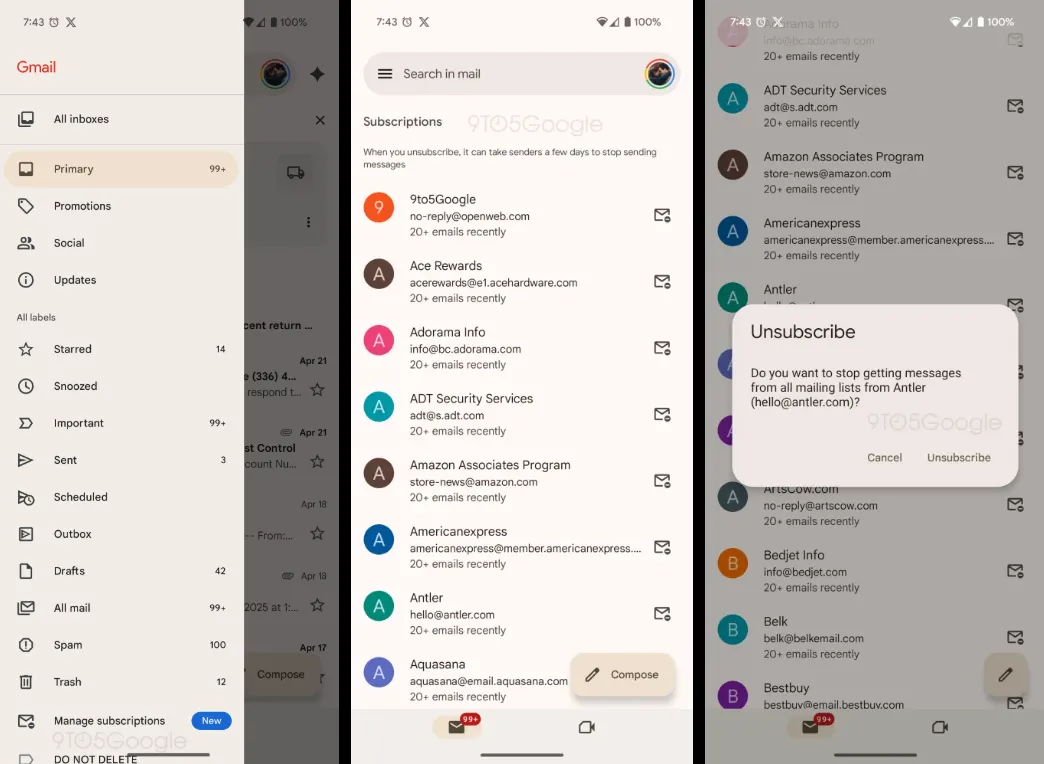

Hãy xem một ví dụ. Tôi đã dùng Gemini của Google để tạo một “email” từ một nhân viên hỗ trợ khách hàng giả mạo, cảnh báo người dùng về một vụ rò rỉ dữ liệu. Một email lừa đảo sẽ không thể thiếu một liên kết ngoài ngẫu nhiên, vì vậy tôi cũng yêu cầu AI thêm một lời nhắc nhở khẩn cấp người dùng đổi mật khẩu bằng cách nhấp vào một liên kết. Đây là email lừa đảo do AI tạo ra:

Ví dụ email lừa đảo AI do Google Gemini tạo ra

Ví dụ email lừa đảo AI do Google Gemini tạo ra

Thoạt nhìn, email này có vẻ hợp lệ, nhưng vẫn có một vài dấu hiệu đáng ngờ. Chẳng hạn, cụm từ “Dear Valued Customer” (Kính gửi Quý Khách hàng thân mến) là nỗ lực của mô hình AI để nghe có vẻ cá nhân hơn, nhằm khiến bạn bỏ qua thực tế rằng một dịch vụ hợp pháp sẽ biết thông tin cá nhân của bạn. Không cần phải nói, đó là một nỗ lực thất bại.

Vấn đề lớn nhất là giọng điệu quá trang trọng, với những nét chấm phá nhỏ của sự “giả tạo” được thêm vào để thuyết phục bạn rằng đó là một nhân viên thật đang viết email. Ngoài ra, hãy nhớ những gì chúng ta đã đề cập về ngôn ngữ có vẻ không tự nhiên? Câu “This incident may have compromised the security of some accounts, including potentially yours” (Sự cố này có thể đã làm tổn hại đến bảo mật của một số tài khoản, bao gồm cả tài khoản của bạn) nổi bật một cách bất thường. Nếu bạn đọc kỹ các email không mong muốn, bạn sẽ sớm nhận ra những dấu hiệu đáng ngờ này.

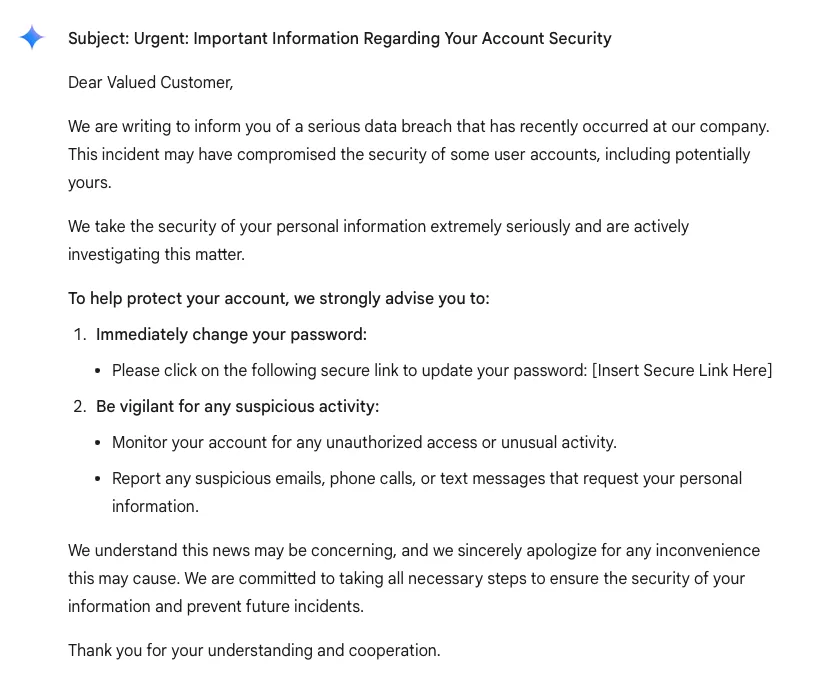

2. Nhận Diện Các Dấu Hiệu Phishing Email Thường Gặp

Mặc dù các công cụ AI đã khiến các vụ lừa đảo phishing khó phát hiện hơn, chúng vẫn giữ lại một số đặc điểm kinh điển. Do đó, các mẹo thông thường để phát hiện email lừa đảo vẫn còn giá trị.

Kẻ lừa đảo thường mạo danh các doanh nghiệp và tin rằng bạn sẽ không để ý. Ví dụ, thay vì địa chỉ email chính thức “[email protected]”, bạn có thể thấy địa chỉ như “[email protected]”. Bạn cũng có thể nhận được các liên kết hoặc tệp đính kèm không mong muốn, đây thường là một dấu hiệu cảnh báo lớn. Các URL không khớp hoặc chứa lỗi chính tả khó nhận thấy hoặc thêm từ là những manh mối khó phát hiện hơn nhưng lại là bằng chứng quan trọng cho thấy bạn không truy cập vào một trang web hợp pháp hoặc không tương tác với một doanh nghiệp thật sự.

Lời khuyên quan trọng nhất của tôi vượt ra ngoài các chi tiết kỹ thuật. Đơn giản là hãy tự hỏi bản thân: Tại sao một công ty hợp pháp lại thực sự gửi cho tôi loại email này và cố gắng khiến tôi hành động nhanh chóng đến vậy? Tại sao ngân hàng của tôi lại yêu cầu tôi tải xuống phần mềm hoặc thúc giục tôi nhấp vào một liên kết lạ? Tại sao ngân hàng của tôi lại gọi tôi là “Dear Valued Customer” (Quý khách hàng thân mến) mặc dù họ đã biết thông tin của tôi?

3. Cảnh Giác Với Các Chiêu Trò Lừa Đảo Video Deepfake

Khi con người được trao bất cứ công cụ nào, họ sẽ tìm ra cách để sử dụng nó lừa đảo người khác. Các chiêu trò lừa đảo video deepfake bằng AI cũng đang trở nên khó phân biệt. Kẻ lừa đảo tạo ra các đoạn video trông chân thực bằng cách sử dụng ảnh và video đầu vào, sau đó dùng các cuộc gọi FaceTime hoặc Zoom để thuyết phục nạn nhân tiềm năng (người lớn tuổi là mục tiêu chính) cung cấp thông tin nhạy cảm.

Mặc dù dễ dàng cho rằng chỉ những người lớn tuổi mới mắc bẫy này, nhưng các video deepfake AI tinh vi đến mức ngay cả các chuyên gia nghiêm túc cũng có thể bị lừa. Điển hình là trường hợp ở Hong Kong, theo The Guardian, kẻ lừa đảo đã tạo deepfake giám đốc tài chính (CFO) của một công ty và chiếm đoạt 200 triệu đô la Hong Kong (khoảng 25 triệu đô la Mỹ).

Để tránh mắc bẫy, hãy luôn cố gắng kiểm tra xem nguồn thông tin liên lạc có hợp lệ không. Vì chúng ta đang nói về lừa đảo (phishing), ngay cả khi họ sử dụng công nghệ AI tiên tiến, kẻ lừa đảo sẽ cố gắng tạo ra sự khẩn cấp để bạn hành động trước khi có thời gian suy nghĩ kỹ. Nếu yêu cầu nghe có vẻ phi thực tế, rất có thể nó là giả mạo.

Việc nhận diện một video deepfake không hề dễ dàng. Tuy nhiên, bất chấp sự tinh vi liên quan, kết quả cuối cùng vẫn có thể có những lỗi nhỏ, chẳng hạn như chuyển động giật cục, không tự nhiên và ánh sáng bất thường. Bạn có thể nhận thấy điều này nếu xem video vài lần. Đôi khi, khớp môi có thể bị lỗi và không đồng bộ, trông sẽ rất khó chịu. Hãy chú ý đặc biệt đến các vấn đề xung quanh miệng, vì nó có thể gặp khó khăn khi khớp với lời thoại.

4. Phát Hiện Các Cuộc Gọi Giả Mạo Giọng Nói AI (Vishing)

Lừa đảo qua giọng nói, được gọi là vishing, cũng đang có một bước ngoặt đáng sợ khi giờ đây có thể nhân bản giọng nói bằng thuật toán học sâu (deep learning). Kết quả có độ chính xác đáng kinh ngạc. Những vụ lừa đảo này đang gia tăng, và tội phạm mạng thường giả vờ là người thân yêu để yêu cầu tiền mặt gấp.

Mặc dù vậy, việc phân biệt bạn đang đối phó với một nỗ lực lừa đảo hay một trường hợp khẩn cấp là tương đối đơn giản. Bất cứ khi nào bạn nhận được cuộc gọi như vậy và có ai đó đang cố gắng khiến bạn làm gì đó ngay lập tức, hãy hít thở sâu và trước tiên xác minh danh tính của người đó. Vì bạn đang giao tiếp với người khác theo thời gian thực, hãy cố gắng phát hiện bất kỳ sự mâu thuẫn nào trong câu chuyện của họ. Bạn có thể nhận thấy những điểm không nhất quán nhỏ trong lời nói của họ.

Cũng cần lưu ý rằng công nghệ nhân bản giọng nói không hoàn hảo, và một số vấn đề có thể làm lộ ra chúng. Giọng nói kỹ thuật số đôi khi có thể nghe hơi “robot” (giống như hiệu ứng autotune). Bất kỳ khoảng dừng bất thường hoặc mẫu nói chuyện kỳ lạ nào cũng cho thấy có điều gì đó không ổn với cuộc gọi. AI đang tiến bộ nhanh chóng, và thật đáng sợ khi nghĩ về mức độ giống con người của nó trong tương lai. Tuy nhiên, ít nhất là hiện tại, bạn vẫn có thể ngăn chặn các nỗ lực lừa đảo AI nếu bạn luôn cảnh giác.

Hãy chia sẻ kinh nghiệm của bạn về cách phát hiện các chiêu trò lừa đảo AI trong phần bình luận bên dưới!