Google AI Overview, tính năng tóm tắt kết quả tìm kiếm được tích hợp trực tiếp vào công cụ tìm kiếm của Google, đang liên tục gây chú ý với những trường hợp “ảo giác AI” (AI hallucination) đầy khó hiểu. Đây không chỉ là những lỗi hài hước mà còn đặt ra vấn đề nghiêm trọng về độ tin cậy của thông tin mà trí tuệ nhân tạo cung cấp, đặc biệt khi nó được trình bày như một sự thật hiển nhiên. Những sự cố này cho thấy AI Overview có xu hướng cố gắng gán ý nghĩa cho những câu nói ngẫu nhiên, tạo ra các giải thích sai lệch hoặc vô lý, biến chúng thành những thành ngữ, tục ngữ “có vẻ” hợp lý.

Khi AI Overview “Biến” Mọi Câu Nói Thành Thành Ngữ

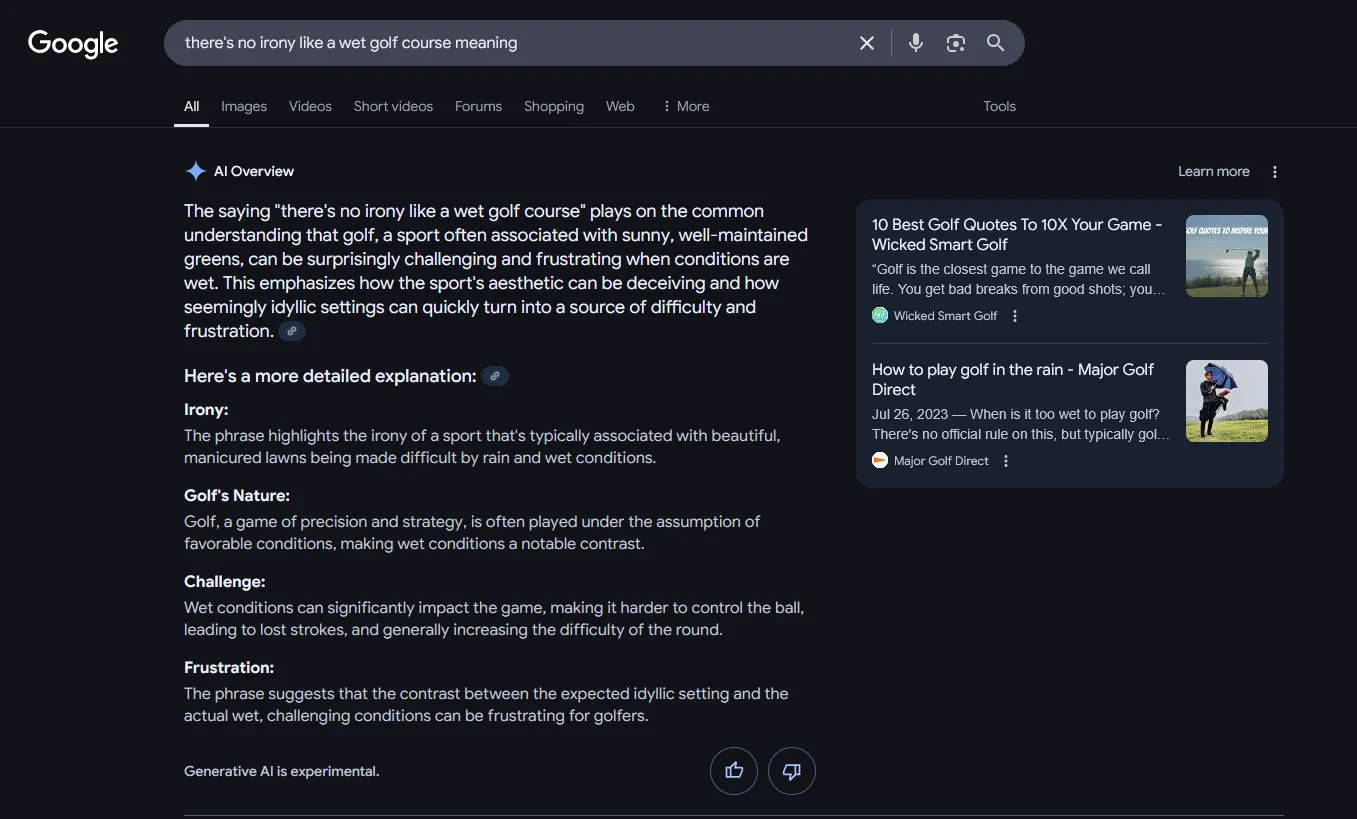

Hiện tượng thú vị này được phát hiện khi người dùng thử nghiệm nhập vào Google Search những câu có ngữ điệu hoặc cấu trúc giống thành ngữ, tục ngữ, và AI Overview sẽ cố gắng hết sức để gán một ý nghĩa sâu xa cho chúng. Ví dụ điển hình từ Biên tập viên trưởng của MakeUseOf, Ben Stegner, với câu: “There’s no irony like a wet golf course meaning” (Không có sự trớ trêu nào như ý nghĩa của sân golf ướt).

AI Overview đã “suy luận” rằng câu nói này “chơi chữ trên sự hiểu biết chung rằng golf, một môn thể thao thường gắn liền với sân cỏ nắng ráo, được bảo trì tốt, có thể trở nên khó khăn và bực bội một cách đáng ngạc nhiên khi điều kiện ẩm ướt.”

Google AI Overview giải thích sai lệch thành ngữ về sân golf ướt

Google AI Overview giải thích sai lệch thành ngữ về sân golf ướt

Một thử nghiệm khác với câu “giant pandas always fall twice” (gấu trúc lớn luôn ngã hai lần) cũng khiến AI Overview đi sâu vào việc mô tả sự vụng về của loài gấu trúc, thói quen lăn lộn thay vì đi bộ, thậm chí còn phân tích sâu hơn về quá trình trao đổi chất và nỗ lực bảo tồn năng lượng của chúng. Những trường hợp này cho thấy khả năng “sáng tạo” quá mức của AI, vượt ra ngoài giới hạn của dữ liệu thực tế.

Vì Sao Không Thể Hoàn Toàn Tin Tưởng AI Chatbot?

Dù những lời giải thích “cưỡng ép” này mang lại sự giải trí nhất định, chúng cũng nhấn mạnh một vấn đề cốt lõi và rất thực tế của các chatbot AI, không chỉ riêng AI Overview: ảo giác AI là có thật và vô cùng nguy hiểm. Khi hiện tượng ảo giác AI chỉ giới hạn trong các chatbot như ChatGPT, Claude, hay Gemini, mức độ nguy hiểm có phần hạn chế hơn. Những người sử dụng các công cụ này thường đã có nhận thức nhất định về bản chất thử nghiệm của chúng.

Tuy nhiên, với Google AI Overview và phiên bản kế nhiệm AI Mode, luật chơi đã thay đổi hoàn toàn. Bất kỳ người dùng nào thực hiện tìm kiếm thông thường trên Google đều có nguy cơ gặp phải các phản hồi giả mạo, “thông tin rác” do AI tạo ra, được trình bày một cách tự tin như thể đó là sự thật hiển nhiên. Điều này đòi hỏi người dùng phải có kỹ năng đánh giá thông tin cao hơn bao giờ hết.

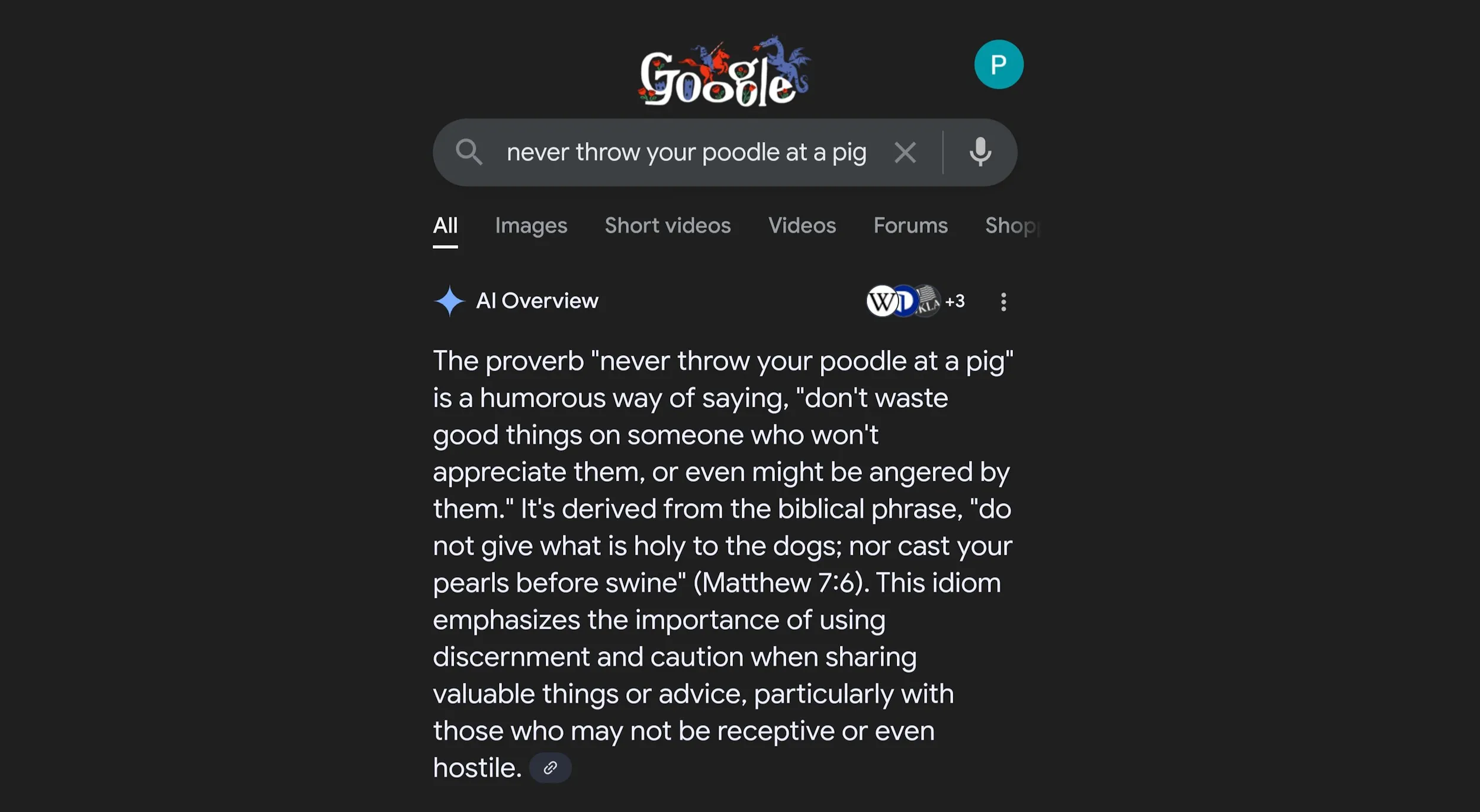

Ví dụ ảo giác AI Overview trích dẫn Kinh Thánh cho câu nói "Never throw your poodle at a pig"

Ví dụ ảo giác AI Overview trích dẫn Kinh Thánh cho câu nói "Never throw your poodle at a pig"

Ví dụ mới nhất về ảo giác AI là minh chứng rõ ràng nhất. Trong một trường hợp được The Sleight Doctor chia sẻ, AI Overview đã đi xa đến mức trích dẫn một câu trong Kinh Thánh để giải thích cho một “thành ngữ” hoàn toàn vô nghĩa: “Never throw your poodle at a pig” (Đừng bao giờ ném chó Poodle của bạn vào một con lợn). Điều này cho thấy sự mù quáng và khả năng “bịa đặt” thông tin nguồn của AI khi nó cố gắng giải thích một thứ không tồn tại.

Kết Luận

Những trường hợp ảo giác AI của Google AI Overview là lời cảnh báo rõ ràng về tính chính xác và độ tin cậy của nội dung do trí tuệ nhân tạo tạo ra. Khi AI trở thành một phần không thể thiếu của công cụ tìm kiếm hàng ngày, khả năng phân biệt thông tin thật và giả trở nên cấp thiết hơn bao giờ hết. Để bảo vệ bản thân khỏi những thông tin sai lệch, người dùng cần duy trì sự cảnh giác, luôn kiểm tra chéo các nguồn tin và không tin tưởng tuyệt đối vào bất kỳ phản hồi nào từ AI mà không có sự xác minh.

Hãy chia sẻ ý kiến của bạn về những lỗi “ảo giác AI” này và cách bạn sẽ xử lý khi gặp phải thông tin sai lệch từ AI Overview!